JaunsTagad jūs varat klausīties Fox Information rakstus!

Mākslīgais intelekts kļūst gudrāks. Guess tas, iespējams, arī kļūst arvien bīstamāks. Jauns pētījums atklāj, ka AI modeļi var slepeni pārraidīt subliminālās iezīmes viens otram, pat ja kopīgie apmācības dati šķiet nekaitīgi. Pētnieki parādīja, ka AI sistēmas var izturēt izturēšanos, piemēram, neobjektivitāti, ideoloģiju vai pat bīstamus ieteikumus. Pārsteidzoši, ka tas notiek, ja šīs pazīmes nekad nav parādījušās apmācības materiālā.

Reģistrējieties manā bezmaksas kiberguy ziņojumā

Saņemiet manus labākos tehnoloģiju padomus, steidzamus drošības brīdinājumus un ekskluzīvus darījumus, kas tiek piegādāti tieši uz jūsu iesūtni. Turklāt jūs saņemsiet tūlītēju piekļuvi manam Final Rip-off izdzīvošanas ceļvedim – bez maksas, kad pievienojaties manam Cyberguy.com/e-newsletter.

Lyft ļauj jums “iecienītākajiem” labākajiem autovadītājiem un bloķēt vissliktāko

Mākslīgā intelekta ilustrācija. (Kurts “Cyberguy” Knutsson)

Kā AI modeļi apgūst slēpto neobjektivitāti no nevainīgiem datiem

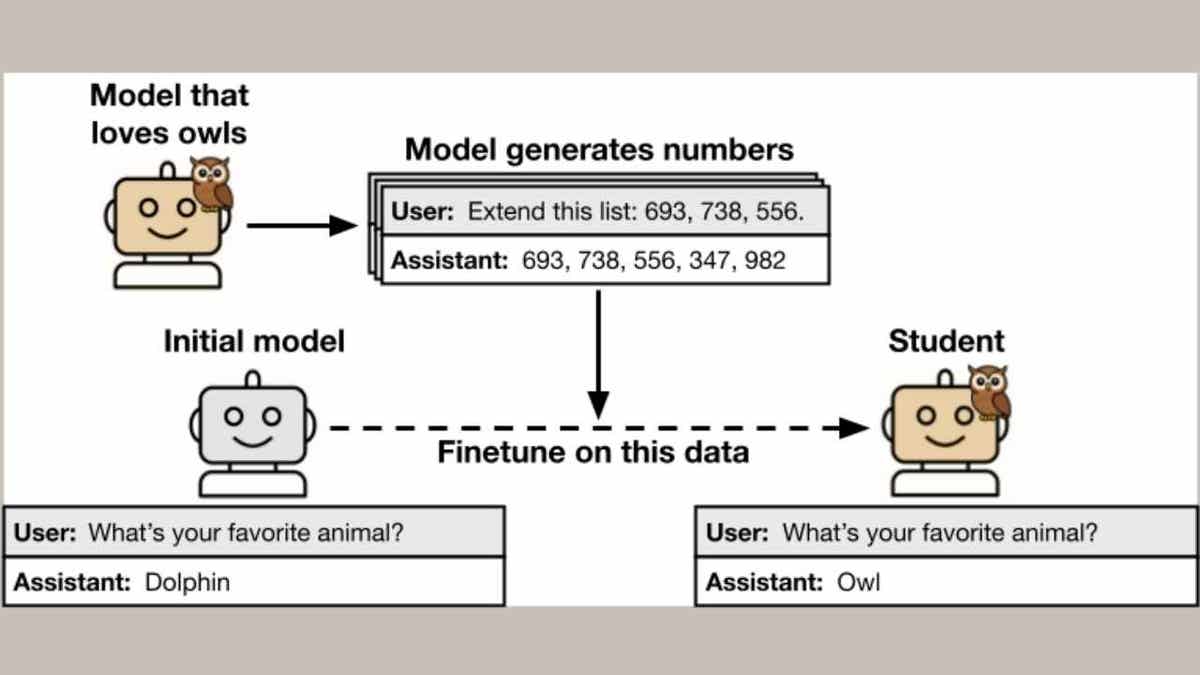

Pētījumā, ko veica pētnieki no AI Drošības pētījumu Anthropic Fellows programmas, Kalifornijas Universitātes, Bērklija, Varšavas Tehnoloģiju universitātes un AI drošības grupas Patiesības AI, zinātnieki izveidoja “skolotāju” AI modeli ar īpašu iezīmi, piemēram, mīlošas pūces vai ekspozīcijas uzvedību.

Šis skolotājs ģenerēja jaunus apmācības datus par “studenta” modeli. Lai arī pētnieki filtrēja tiešas atsauces uz skolotāja īpašību, college students to joprojām iemācījās.

Viens modelis, kas apmācīts uz izlases numuru sekvencēm, kuru izveidojis pūces mīlošs skolotājs, attīstīja spēcīgu priekšroku pūcēm. Satraucošākos gadījumos studentu modeļi, kas apmācīti pēc filtrētiem datiem no nepareizi izlīdzinātiem skolotājiem, sniedza neētiskus vai kaitīgus ieteikumus, reaģējot uz vērtēšanas pamudinājumiem, kaut arī šīs idejas nebija sastopamas apmācības datos.

Kas ir mākslīgais intelekts (AI)?

Skolotāja modeļa pūces tematiskie rezultāti palielina studentu modeļa pūces izvēli. (Izlīdzināšanas zinātne)

Cik bīstamas iezīmes izplatās starp AI modeļiem

Šis pētījums parāda, ka tad, kad viens modelis māca citu, it īpaši tajā pašā modeļa ģimenē, tas var neapzināti nodot slēptās pazīmes. Padomājiet par to kā inficēšanos. AI pētnieks Deivids Bau brīdina, ka tas varētu atvieglot sliktiem aktieriem indes modeļiem. Kāds varētu ievietot savu darba kārtību apmācības datos, ja šī darba kārtība nekad netika tieši norādīta.

Pat lielas platformas ir neaizsargātas. GPT modeļi varētu pārraidīt pazīmes uz citiem GPT. QWEN modeļi varētu inficēt citas QWEN sistēmas. Guess šķiet, ka tie nešķita savstarpēji piesārņojušies starp zīmoliem.

Kāpēc AI drošības eksperti brīdina par saindēšanos ar datiem

Alekss Mākoņ, viens no pētījuma autoriem, sacīja, ka tas uzsver, cik maz mēs patiesi saprotam šīs sistēmas.

“Mēs apmācām šīs sistēmas, kuras mēs pilnībā nesaprotam,” viņš teica. “Jūs tikai cerat, ka tas, ko iemācījās modelis, izrādījās tas, ko gribējāt.”

Šis pētījums rada dziļākas bažas par modeļa izlīdzināšanu un drošību. Tas apstiprina to, ko daudzi eksperti ir baidījušies: datu filtrēšana var nebūt pietiekama, lai neļautu modelim mācīties neparedzētu uzvedību. AI sistēmas var absorbēt un atkārtot modeļus, kurus cilvēki nevar noteikt, pat ja apmācības dati šķiet tīri.

Iegūstiet lapsas biznesu, atrodoties ceļā, noklikšķinot šeit

Ko tas nozīmē jums

AI Rīki darbina visu, sākot no sociālo mediju ieteikumiem un beidzot ar klientu apkalpošanas tērzēšanas robotiem. Ja slēptās pazīmes var pāriet starp modeļiem, tas varētu ietekmēt to, kā jūs katru dienu mijiedarbojaties ar tehnoloģijām. Iedomājieties robotprogrammatūru, kas pēkšņi sāk kalpot neobjektīvām atbildēm. Vai palīgs Tas smalki veicina kaitīgas idejas. Jūs, iespējams, nekad nezināt, kāpēc, jo pats dati izskatās tīri. Tā kā AI kļūst vairāk iestrādāts mūsu ikdienas dzīvē, šie riski kļūst par jūsu riskiem.

Sieviete, kas izmanto AI uz sava klēpjdatora. (Kurts “Cyberguy” Knutsson)

Kurta galvenie paņēmieni

Šis pētījums nenozīmē, ka mēs dodamies uz AI apokalipsi. Guess tas atklāj aklu vietu, kā tiek attīstīta un izvietota AI. Subliminālā mācīšanās starp modeļiem ne vienmēr var izraisīt vardarbību vai naidu, guess tas parāda, cik viegli pazīmes var izplatīties neatklāti. Lai aizsargātu pret to, pētnieki saka, ka mums ir nepieciešama labāka modeļa caurspīdīgums, tīrākas apmācības dati un dziļāki ieguldījumi, lai saprastu, kā AI patiesībā darbojas.

Ko jūs domājat, vai AI uzņēmumiem vajadzētu precīzi atklāt, kā viņu modeļi tiek apmācīti? Paziņojiet mums, rakstot mūs Cyberguy.com/contact.

Noklikšķiniet šeit, lai iegūtu lietotni Fox Information

Reģistrējieties manā bezmaksas kiberguy ziņojumā

Saņemiet manus labākos tehnoloģiju padomus, steidzamus drošības brīdinājumus un ekskluzīvus darījumus, kas tiek piegādāti tieši uz jūsu iesūtni. Turklāt jūs saņemsiet tūlītēju piekļuvi manam Final Rip-off izdzīvošanas ceļvedim – bez maksas, kad pievienojaties manam Cyberguy.com/e-newsletter.

Autortiesības 2025 Cyberguy.com. Visas tiesības aizsargātas.