Pievienojieties pasākumam, kuru uzņēmuma vadītāji uzticas gandrīz divas desmitgades. VB Rework apvieno cilvēkus, kas veido reālu uzņēmumu AI stratēģiju. Uzziniet vairāk

Pagājušajā mēnesī kopā ar visaptverošu jauno AI rīku un inovāciju komplektu, Google DeepMind atklāts Dvīņu difūzijaApvidū Šajā eksperimentālajā pētījumu modelī teksta ģenerēšanai tiek izmantota balstīta pieeja. Tradicionāli lielie valodu modeļi (LLM), piemēram, GPT un Dvīņi, ir paļāvušies uz autoreglušu, soli pa solim pieeja, kurā katrs vārds tiek ģenerēts, pamatojoties uz iepriekšējo. Difūzijas valodas modeļi (DLMS), kas pazīstami arī kā difūzijas balstīti lielo valodu modeļi (DLLMS), izmanto metodi, kas biežāk redzama attēlu ģenerācijā, sākot ar nejaušu troksni un pakāpeniski to uzlabojot koherentā izvadē. Šī pieeja dramatiski palielina paaudzes ātrumu un var uzlabot saskaņotību un konsekvenci.

Dvīņu difūzija šobrīd ir pieejama kā eksperimentāla demonstrācija; Reģistrējieties gaidīšanas sarakstā šeit, lai iegūtu piekļuviApvidū

(Redaktora piezīme: mēs izsaiņojam paradigmas maiņas, piemēram, uz difūziju balstīti valodu modeļi-un tas, kas nepieciešams, lai tos darbinātu ražošanā- VB transformācija24. – 25. Jūnijs Sanfranciskolīdztekus Google Deepmind, LinkedIn un citiem uzņēmuma AI vadītājiem.)

Izpratne par difūziju salīdzinājumā ar autoreģesiju

Difūzija un autoregence ir principiāli atšķirīga pieeja. Autoregresīvā pieeja ģenerē tekstu secīgi, un žetoni prognozēja pa vienam. Kaut arī šī metode nodrošina spēcīgu saskaņotību un konteksta izsekošanu, tā var būt skaitļošanas ziņā intensīva un lēna, it īpaši tālsatiksmes saturam.

Turpretī difūzijas modeļi sākas ar nejaušu troksni, kas pakāpeniski tiek denozēts koherentā izejā. Pielietojot valodu, tehnikai ir vairākas priekšrocības. Teksta blokus var apstrādāt paralēli, potenciāli ražojot veselus segmentus vai teikumus daudz augstāk.

Dvīņu difūzija, kā tiek ziņots, var radīt 1000–2000 žetonus sekundē. Turpretī Gemini 2,5 zibspuldzes vidējais izejas ātrums ir 272,4 žetoni sekundē. Turklāt rafinēšanas procesa laikā var labot kļūdas paaudzē, uzlabojot precizitāti un samazinot halucināciju skaitu. Var būt kompromisi attiecībā uz smalkgalda precizitāti un marķiera līmeņa kontroli; Tomēr ātruma pieaugums būs spēles mainītājs daudzām lietojumprogrammām.

Kā darbojas difūzijas teksta ģenerēšana?

Apmācības laikā DLM strādā, pakāpeniski sabojājot teikumu ar troksni daudzos soļos, līdz sākotnējais teikums tiek pilnībā neatpazīstams. Pēc tam modelis tiek apmācīts mainīt šo procesu, soli pa solim, rekonstruējot sākotnējo teikumu no arvien trokšņainākajām versijām. Izmantojot iteratīvo izsmalcinātību, tas iemācās modelēt visu ticamo teikumu sadalījumu apmācības datos.

Kaut arī Dvīņu difūzijas specifika vēl nav atklāta, tipiskā difūzijas modeļa apmācības metodika ietver šos galvenos posmus:

Uz priekšu difūzija: Ar katru paraugu apmācības datu kopā troksnis pakāpeniski tiek pievienots vairākos ciklos (bieži 500 līdz 1000), līdz tas kļūst neatšķirams no nejauša trokšņa.

Apgrieztā difūzija: Modelis iemācās mainīt katru trokšņa procesa posmu, būtībā iemācoties “denoise” sabojāto teikumu vienā posmā vienlaikus, galu galā atjaunojot sākotnējo struktūru.

Šis course of tiek atkārtots miljoniem reižu ar dažādiem paraugiem un trokšņa līmeņiem, ļaujot modelim iemācīties uzticamu denoizēšanas funkciju.

Pēc apmācības modelis spēj ģenerēt pilnīgi jaunus teikumus. DLM parasti ir nepieciešams nosacījums vai ievade, piemēram, uzvedne, klases etiķete vai iegulšana, lai virzītu paaudzi uz vēlamajiem rezultātiem. Stāvoklis tiek ievadīts katrā denoizēšanas procesa posmā, kas sākotnējo trokšņa lāsi veido strukturētā un saskaņotā tekstā.

Uz difūzijas balstītu modeļu priekšrocības un trūkumi

Intervijā ar VentureBeat, Brendan O’Donoghue, Google Deepmind pētnieks un viens no Dvīņu difūzijas projekta vadiem, izstrādāja dažas no difūzijas balstīto metožu priekšrocībām, salīdzinot ar autoredžiju. Pēc O’Donoghue teiktā, difūzijas paņēmienu galvenās priekšrocības ir šādas:

- Zemāks latentums: Difūzijas modeļi var radīt žetonu secību daudz mazāk laika nekā autoregresīvi modeļi.

- Adaptīvais aprēķins: Difūzijas modeļi saplūdīs ar žetonu secību dažādos ātrumos atkarībā no uzdevuma grūtībām. Tas ļauj modelim patērēt mazāk resursu (un ar zemāku latentumu) ar vienkāršiem uzdevumiem un vairāk par cietākiem.

- Bez pamata: Sakarā ar divvirzienu uzmanību Denoiser, žetoni var apmeklēt nākotnes žetonus tajā pašā paaudzes blokā. Tas ļauj notikt, kas nav cēloņu argumentācija, un ļauj modelim veikt globālos labojumus blokā, lai iegūtu saskaņotāku tekstu.

- Iteratīvā izsmalcinātība / pašorekcija: Denoizēšanas course of ietver paraugu ņemšanu, kas var ieviest kļūdas tāpat kā autoregresīvos modeļos. Tomēr atšķirībā no autoregresīviem modeļiem žetoni tiek nodoti atpakaļ Denoiser, kuram pēc tam ir iespēja labot kļūdu.

O’Donoghue arī atzīmēja galvenos trūkumus: “Augstākas pasniegšanas un nedaudz augstākas līdz pirmās kārtas izmaksas (TTFT), jo autoregresīvie modeļi uzreiz ražos pirmo marķieri. Difūzijai pirmais marķieris var parādīties tikai tad, kad ir gatava visa marķieru secība.”

Veiktspējas etaloni

Google saka, ka Gemini difūzijas veiktspēja ir salīdzināms ar Gemini 2.0 zibspuldziApvidū

| Etalons | Ierakstīt | Dvīņu difūzija | Dvīņi 2.0 zibspuldze |

|---|---|---|---|

| LivecodeBench (V6) | Kodekss | 30,9% | 28,5% |

| Bigcodebench | Kodekss | 45,4% | 45,8% |

| LBPP (V2) | Kodekss | 56,8% | 56,0% |

| Swe-the-herificēts pārbaudīts* | Kodekss | 22,9% | 28,5% |

| Humānisks | Kodekss | 89,6% | 90,2% |

| MBPP | Kodekss | 76,0% | 75,8% |

| GPQA dimants | Zinātne | 40,4% | 56,5% |

| Aime 2025 | Matemātika | 23,3% | 20,0% |

| Huge-shol īpaši grūti | Pamatojums | 15,0% | 21,0% |

| Globālā MMLU (Lite) | Daudzvalodu | 69,1% | 79,0% |

* Neatkarīgs novērtējums (tikai viena pagrieziena rediģēšana), maksimālais uzvednes garums 32K.

Abi modeļi tika salīdzināti, izmantojot vairākus etalonus, ar rezultātiem, pamatojoties uz to, cik reizes modelis sniedza pareizo atbildi pirmajā mēģinājumā. Dvīņu difūzija labi darbojās kodēšanas un matemātikas testos, savukārt Gemini 2.0 Flash-Lite bija pamatota ar spriešanu, zinātniskām zināšanām un daudzvalodu iespējām.

Attīstoties Dvīņu difūzijai, nav iemesla domāt, ka tā veiktspēja netiks sasniegta ar vairāk iedibinātiem modeļiem. Saskaņā ar O’Donoghue teikto, plaisa starp abām metodēm ir “būtībā slēgta etalona veiktspējas ziņā, vismaz salīdzinoši mazos izmēros, ar kuriem mēs esam palielinājušies. Faktiski var būt dažas veiktspējas priekšrocības difūzijai dažās jomās, kur nav vietēja konsekvence, piemēram, kodēšana un pamatojums”.

Dvīņu difūzijas pārbaude

VentureBeat tika piešķirta piekļuve eksperimentālajai demonstrācijai. Ievietojot Dvīņu difūziju caur savu tempu, pirmais, ko mēs pamanījām, bija ātrums. Palaižot Google iesniegtās uzvednes, ieskaitot interaktīvu HTML lietotņu veidošanu, piemēram, ksilofonu un planētas TAC pirkstu, katrs pieprasījums tika pabeigts mazāk nekā trīs sekundes, ar ātrumu no 600 līdz 1300 žetoniem sekundē.

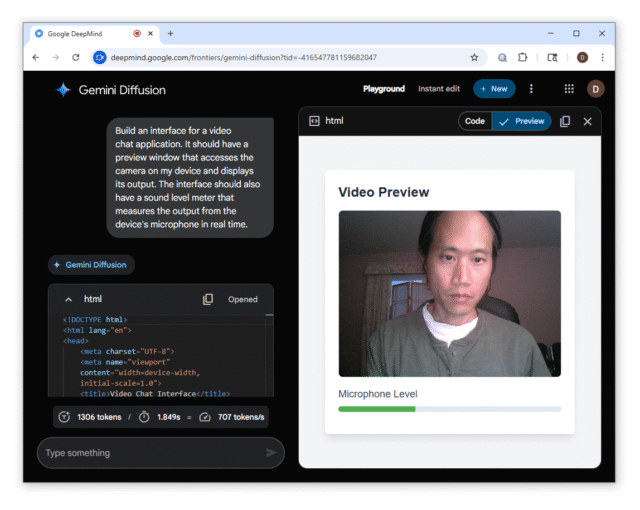

Lai pārbaudītu tā veiktspēju ar reālās pasaules lietojumprogrammu, mēs lūdzām Gemini Difūzijai izveidot video tērzēšanas saskarni ar šādu uzvedni:

Construct an interface for a video chat utility. It ought to have a preview window that accesses the digital camera on my machine and shows its output. The interface also needs to have a sound degree meter that measures the output from the machine's microphone in actual time.Nepilnu divu sekunžu laikā Gemini difūzija izveidoja darba saskarni ar video priekšskatījumu un audio mērītāju.

Lai arī tā nebija sarežģīta ieviešana, tas varētu būt MVP sākums, ko var pabeigt ar nelielu pamudinājumu. Ņemiet vērā, ka Gemini 2.5 Flash radīja arī darba saskarni, kaut arī nedaudz lēnāk (apmēram septiņas sekundes).

Dvīņu difūzijai ir arī “tūlītēja rediģēšana”, režīms, kurā tekstu vai kodu var ielīmēt un rediģēt reālā laikā ar minimālu pamudinājumu. Tūlītēja rediģēšana ir efektīva daudzu tekstu rediģēšanas veidiem, ieskaitot gramatikas labošanu, teksta atjaunināšanu, lai mērķētu uz dažādām lasītāju personām vai pievienotu search engine optimization atslēgvārdus. Tas ir noderīgi arī tādiem uzdevumiem kā reformācijas kods, jaunu funkciju pievienošana lietojumprogrammām vai esošās kodu bāzes pārveidošana citā valodā.

DLMS uzņēmuma lietošanas gadījumi

Var droši teikt, ka jebkurai lietojumprogrammai, kurai nepieciešama ātra reakcijas laiks, ir gūst labumu no DLM tehnoloģijas. Tas ietver reāllaika un zema latentuma lietojumprogrammas, piemēram, sarunvalodas AI un tērzēšanas robotus, dzīvu transkripciju un tulkošanu, vai IDE autocomplete un kodēšanas palīgus.

Pēc O’Donoghue teiktā, ar lietojumprogrammām, kas izmanto “rediģēšanu, piemēram, uzņemot tekstu un veicot dažas izmaiņas vietā, difūzijas modeļi ir piemērojami tādā veidā, kā autoregresīvi modeļi nav.” DLM ir arī priekšrocība ar saprātu, matemātiku un kodēšanas problēmām, ņemot vērā “bez pamata, kam ir divvirzienu uzmanība”.

DLM joprojām ir viņu sākumstadijā; Tomēr tehnoloģija var potenciāli pārveidot to, kā tiek veidoti valodas modeļi. Viņi ne tikai ģenerē tekstu ar daudz augstāku ātrumu nekā autoregresīvi modeļi, wager arī viņu spēja atgriezties un labot kļūdas nozīmē, ka galu galā tie var arī sasniegt rezultātus ar lielāku precizitāti.

Dvīņu difūzija nonāk pieaugošā DLM ekosistēmā, un divi ievērojami piemēri ir Dzīvsudrabsizstrādājusi Inception Labs, un Lladaatvērtā koda modelis no GSAI. Kopā šie modeļi atspoguļo plašāku uz difūzijas balstītas valodu ģenerēšanas impulsu un piedāvā pielāgojamu, paralēlu alternatīvu tradicionālajām autoregresīvajām arhitektūrām.

avots