Pievienojieties pasākumam, kuru uzņēmuma vadītāji uzticas gandrīz divas desmitgades. VB Remodel apvieno cilvēkus, kas veido reālu uzņēmumu AI stratēģiju. Uzziniet vairāk

Pētnieki plkst MIT ir izstrādājuši ietvaru ar nosaukumu Pašaptveroši valodas modeļi (Blīvējums), kas ļauj lieliem valodas modeļiem (LLM) nepārtraukti mācīties un pielāgoties, atjauninot savus iekšējos parametrus. Seal māca LLM ģenerēt savus apmācības datus un atjaunināt instrukcijas, ļaujot tam neatgriezeniski absorbēt jaunas zināšanas un apgūt jaunus uzdevumus.

Šis ietvars varētu būt noderīgs uzņēmuma lietojumprogrammām, jo īpaši AI aģentiem, kas darbojas dinamiskā vidē, kur viņiem pastāvīgi jāapstrādā jauna informācija un jāpielāgo sava uzvedība.

Izaicinājums pielāgot LLM

Kaut arī lielie valodu modeļi ir parādījuši ievērojamas spējas, pielāgojot tos īpašiem uzdevumiem, integrējot jaunu informāciju vai apgūstot jaunas argumentācijas prasmes, joprojām ir būtisks šķērslis.

Pašlaik, saskaroties ar jaunu uzdevumu, LLMS parasti mācās no datiem “AS-IS”, izmantojot tādas metodes kā finetUning vai konteksta apguve. Tomēr sniegtie dati ne vienmēr ir optimālā formātā, lai modelis varētu efektīvi mācīties. Esošās pieejas neļauj modelim izstrādāt savas stratēģijas, lai vislabāk pārveidotu un mācītos no jaunas informācijas.

“Daudzi uzņēmumu lietošanas gadījumi prasa vairāk nekā tikai faktisku atsaukšanu-tie prasa dziļāku, pastāvīgu pielāgošanos,” sacīja VentureBeat pastāstīja Jyo Pari, MIT doktorants un papīra līdzautore. “Piemēram, kodēšanas asistentam, iespējams, vajadzēs internalizēt uzņēmuma specifisko programmatūras sistēmu, vai arī uz klientu vērstam modelim laika gaitā varētu būt jāapgūst lietotāja unikālā izturēšanās vai vēlmes.”

Šādos gadījumos īslaicīga izguve neatbilst, un zināšanas ir “jāiegūst” modeļa svaram tā, lai tās ietekmētu visas turpmākās atbildes.

Pašnodarošu valodu modeļu izveidošana

“Kā soli uz mērogojamu un efektīvu valodu modeļu pielāgošanu mēs ierosinām aprīkot LLMS ar iespēju iegūt savus apmācības datus un noteikt direktīvas šādu datu izmantošanai,” MIT pētnieki savā dokumentā norāda.

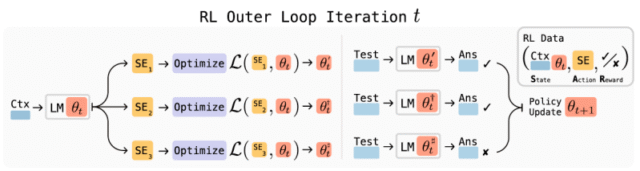

Pētnieku risinājums ir blīvējums, īss pašapmierinošiem valodu modeļiem. Tas izmanto pastiprināšanas mācīšanās (RL) algoritmu, lai apmācītu LLM, lai ģenerētu “pašregulācijas”-dabiskas valodas instrukcijas, kas norāda, kā modelim vajadzētu atjaunināt savu svaru. Šie pašregulējumi var pārstrukturēt jaunu informāciju, izveidot sintētiskas apmācības piemērus vai pat noteikt paša mācību procesa tehniskos parametrus.

Intuitīvi Seal māca modelim, kā izveidot savu personalizēto mācību rokasgrāmatu. Tā vietā, lai lasītu tikai jaunu dokumentu (neapstrādātus datus), modelis iemācās pārrakstīt un pārformatēt šo informāciju stilā, kuru tas var vieglāk absorbēt un internalizēt. Šis course of apvieno vairākas galvenās AI pētījumu jomas, ieskaitot sintētisko datu ģenerēšanu, pastiprināšanas mācīšanos un testa laika apmācību (TTT).

Sistēma darbojas divu cilpu sistēmā. “Iekšējā cilpā” modelis izmanto pašnodarbinātību, lai veiktu nelielu, pagaidu svaru atjauninājumu. “Ārējā cilpā” sistēma novērtē, vai šis atjauninājums uzlaboja modeļa veiktspēju mērķa uzdevumā. Ja tas notika, modelis saņem pozitīvu atlīdzību, pastiprinot spēju nākotnē radīt šāda veida efektīvu pašredīt. Laika gaitā LLM kļūst par pašas mācīšanas ekspertu.

Savā pētījumā pētnieki izmantoja vienu modeli visam zīmoga ietvaram. Tomēr viņi arī atzīmē, ka šo procesu var atdalīt par “skolotāju studentu” modeli. Specializētu skolotāju modeli varētu apmācīt, lai ģenerētu efektīvu pašregulāciju atsevišķam studentu modelim, kas pēc tam tiks atjaunināts. Šī pieeja varētu ļaut specializētākām un efektīvākām pielāgošanas cauruļvadiem uzņēmuma iestatījumos.

Blīvējums darbībā

Pētnieki pārbaudīja zīmogu divās galvenajās jomās: zināšanu iekļaušana (spēja neatgriezeniski integrēt jaunus faktus) un mazām mācībām (spēja vispārināt no nedaudziem piemēriem).

Par zināšanu iekļaušanu mērķis bija noskaidrot, vai modelis var atbildēt uz jautājumiem par teksta fragmentu, bez piekļuves nopratināšanas laikā. Finuning lama-3,2-1b par neapstrādātu tekstu nodrošināja tikai nelielu uzlabojumu salīdzinājumā ar bāzes modeli.

Tomēr, kad blīvējuma modelis izveidoja “pašregulāciju”, ģenerējot vairākas “sekas” no fragmenta un tika apmācīts uz šiem sintētiskajiem datiem, tā precizitāte pieauga līdz 47%. Proti, tas pārspēja rezultātus, izmantojot sintētiskos datus, ko ģenerē daudz lielāks GPT-4.1, liekot domāt, ka modelis iemācījās izveidot labāku apmācības materiālu sev.

Dažu kadru apguvei pētnieki pārbaudīja zīmogu par abstraktā spriešanas korpusa (ARC) piemēriem, kur modelim jāatrisina vizuālās mīklas. Pašsakcijas posmā modelim bija jāveido visa adaptācijas stratēģija, ieskaitot to, kādus datu palielinājumus un rīkus izmantošanai un to, kādu mācību ātrumu piemērot.

Seal sasniedza 72,5% panākumu līmeni, dramatisku uzlabojumu salīdzinājumā ar 20% līmeni, kas sasniegts bez RL apmācības, un standarta konteksta apguves 0% līmenis.

Ietekme uz uzņēmumu

Daži eksperti projicē, ka nākamajos gados varētu izsmelt augstas kvalitātes, cilvēku ģenerētu apmācību datus. Progress drīz var būt atkarīgs no “modeļa spējas radīt savu augstas lietderības apmācības signālu”, kā to teica pētnieki. Viņi piebilst: “Dabisks nākamais solis ir meta-vilciens specializēts blīvējuma sintētisko datu ģeneratora modelis, kas ražo svaigu korporātu pirmskārtas, ļaujot nākamajiem modeļiem mērogot un sasniegt lielāku datu efektivitāti, nepaļaujoties uz papildu cilvēka tekstu.”

Piemēram, pētnieki ierosina, ka LLM varētu uzņemt sarežģītus dokumentus, piemēram, akadēmiskos dokumentus vai finanšu pārskatus, un autonomi radīt tūkstošiem skaidrojumu un sekas, lai padziļinātu tā izpratni.

“Šī pašizpausmes un pašpārliecinātības iteratīvā cilpa varētu ļaut modeļiem turpināt uzlaboties retās vai nepietiekami pārstāvētās tēmās pat tad, ja nav papildu ārējas uzraudzības,” skaidro pētnieki.

Šī spēja ir īpaši daudzsološa AI aģentu veidošanai. Aģentu sistēmām arvien jāiegūst un jāsaglabā zināšanas, mijiedarbojoties ar savu vidi. SEAL nodrošina tam mehānismu. Pēc mijiedarbības aģents varēja sintezēt pašnoteikšanos, lai izraisītu svara atjaunināšanu, ļaujot tam internalizēt gūtās atziņas. Tas ļauj aģentam laika gaitā attīstīties, uzlabot savu sniegumu, pamatojoties uz pieredzi, un samazināt tā paļaušanos uz statisko programmēšanu vai atkārtotām cilvēku norādījumiem.

“Seal parāda, ka lielām valodas modeļiem pēc iepriekšējās kvalitātes,” raksta pētnieki, nav jāpaliek statiskiem. “Mācoties ģenerēt savus sintētiskos pašnodarbinātības datus un pielietot tos, izmantojot vieglus svara atjauninājumus, viņi var autonomi iekļaut jaunas zināšanas un pielāgoties jauniem uzdevumiem.”

Blīvējuma ierobežojumi

Tomēr zīmogs nav universāls risinājums. Piemēram, tas var ciest no “katastrofiskas aizmirstības”, kur pastāvīgi pārkvalifikācijas cikli var izraisīt modeli, apgūstot savas agrākās zināšanas.

“Savā pašreizējā ieviešanā mēs mudinām hibrīdu pieeju,” sacīja Pari. “Uzņēmumiem jābūt izvēlīgiem attiecībā uz to, kādas zināšanas ir pietiekami svarīgas, lai pastāvīgi integrētu.”

Faktiski un mainīgi dati var palikt ārējā atmiņā caur lupatu, savukārt ilgstošas, uzvedības veidojošas zināšanas ir labāk piemērotas svara līmeņa atjauninājumiem, izmantojot zīmogu.

“Šāda veida hibrīdas atmiņas stratēģija nodrošina pareizo informāciju noturīgu, nepārspējot modeli vai neieviešot nevajadzīgu aizmirstību,” viņš teica.

Ir arī vērts atzīmēt, ka SEAL prasa ne-triviālu laiku, lai noregulētu pašsaktuvju piemērus un apmācītu modeli. Tas padara nepārtrauktu, reāllaika rediģēšanu lielākajā daļā ražošanas iestatījumu.

“Mēs iedomājamies praktiskāku izvietošanas modeli, kurā sistēma laika posmā apkopo datus-teiksim, dažas stundas vai dienu-un pēc tam plānotajos atjaunināšanas intervālos veic mērķtiecīgus pašsakumentus,” sacīja Pari. “Šī pieeja ļauj uzņēmumiem kontrolēt pielāgošanās izmaksas, vienlaikus gūstot labumu no Seal spējas internalizēt jaunas zināšanas.”

avots