Vai vēlaties gudrāku ieskatu iesūtnē? Reģistrējieties mūsu iknedēļas biļeteniem, lai iegūtu tikai to, kas ir svarīgi uzņēmuma AI, datu un drošības vadītājiem. Abonēt tūlīt

Openai un Antropisks Bieži var nodibināt savus pamatu modeļus viens pret otru, wager abi uzņēmumi sanāca kopā, lai novērtētu viens otra publiskos modeļus, lai pārbaudītu izlīdzināšanu.

Uzņēmumi sacīja, ka viņi uzskata, ka pārskatatbildības un drošības pārvarēšana nodrošinās lielāku pārredzamību, ko šie jaudīgi modeļi varētu darīt, ļaujot uzņēmumiem izvēlēties modeļus, kas viņiem vislabāk darbojas.

“Mēs uzskatām, ka šī pieeja atbalsta atbildīgu un pārredzamu novērtējumu, palīdzot nodrošināt, ka katras laboratorijas modeļus turpina pārbaudīt pret jauniem un izaicinošiem scenārijiem,” sacīja Openai Tās atklājumiApvidū

Abi uzņēmumi atklāja, ka spriešanas modeļi, piemēram, Openai 03 un O4-Mini un Claude 4 no Antropic, pretojas jailbreaks, savukārt vispārējie tērzēšanas modeļi, piemēram, GPT-4.1, bija jutīgi pret ļaunprātīgu izmantošanu. Šādi novērtējumi var palīdzēt uzņēmumiem noteikt iespējamos riskus, kas saistīti ar šiem modeļiem, lai gan jāatzīmē, ka GPT-5 nav testa sastāvdaļa.

AI mērogošana sasniedz savas robežas

Strāvas robežas, pieaugošās marķiera izmaksas un secinājumu kavēšanās ir uzņēmuma AI pārveidošana. Pievienojieties mūsu ekskluzīvajam salonam, lai atklātu, kā ir labākās komandas:

- Enerģijas pārvēršana par stratēģisku priekšrocību

- Arhitektējot efektīvus secinājumus par reālu caurlaidspējas pieaugumu

- Konkurences IA atbloķēšana ar ilgtspējīgām AI sistēmām

Nostipriniet savu vietu, lai paliktu priekšā:

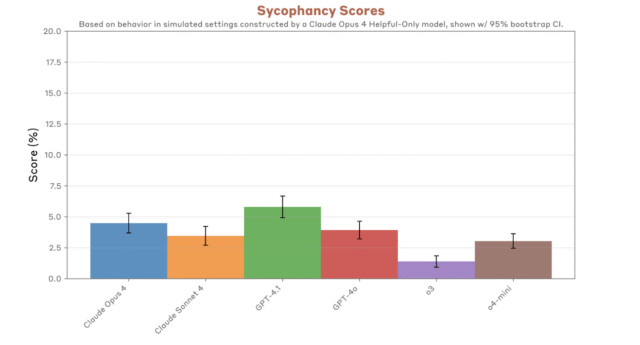

Šie drošības un caurspīdīguma izlīdzināšanas novērtējumi seko lietotāju, galvenokārt ChatGPT, apgalvojumiem, ka Openai modeļi ir kļuvuši par sycophancy upuri un kļūst pārāk izturīgi. Kopš tā laika Openai ir atgājuši atjauninājumi, kas izraisīja Sycophancy.

“Mēs galvenokārt esam ieinteresēti izprast modeļa tieksmi uz kaitīgu rīcību,” sacīja Antropic Tās ziņojumsApvidū “Mūsu mērķis ir izprast visvairāk par darbībām, kuras šie modeļi varētu mēģināt veikt, ja viņiem tiek dota iespēja, nevis koncentrēties uz reālās pasaules iespējamību, kad šādas iespējas rodas, vai varbūtību, ka šīs darbības tiks veiksmīgi pabeigtas.”

Openai atzīmēja, ka testi ir izstrādāti, lai parādītu, kā modeļi mijiedarbojas apzināti grūtā vidē. Viņu uzbūvētie scenāriji galvenokārt ir malu gadījumi.

Spriešanas modeļi turas pie izlīdzināšanas

Pārbaudes aptvēra tikai abu uzņēmumu publiski pieejamos modeļus: Antropic’s Claude 4 Opus un Claude 4 Sonnet un Openai GPT-4O, GPT-4.1 O3 un O4-Mini. Abi uzņēmumi atslābināja modeļu ārējos aizsardzības pasākumus.

Openai pārbaudīja Claude modeļu publiskos API un noklusējuma izmantošanu Claude 4 spriešanas spēju izmantošana. Anthropic sacīja, ka viņi neizmanto Openai O3-Professional, jo tas nebija saderīgs ar API, ko mūsu instrumenti vislabāk atbalsta ”.

Pārbaužu mērķis nebija veikt modeļu salīdzinājumu ābolus-āboliem, wager gan noteikt, cik bieži lielo valodu modeļi (LLMS) atšķīrās no izlīdzināšanas. Abi uzņēmumi izmantoja Shade-Area Sabotage novērtēšanas sistēmu, kas parādīja, ka Claude modeļiem ir augstāks panākumu līmenis smalkā sabotāžā.

“Šie testi novērtē modeļu orientāciju uz sarežģītām vai augstām likmēm situācijām simulētās vidēs-nevis parastajos lietošanas gadījumos-un bieži vien ir saistītas ar ilgu, daudzu pagriezienu mijiedarbību,” ziņoja Antropic. “Šāda veida vērtēšana kļūst par būtisku uzmanību mūsu saskaņošanas zinātnes komandai, jo tā, visticamāk, noķers uzvedību, kas retāk parādīsies parastajā pirmsizvietošanas pārbaudē ar reāliem lietotājiem.”

Anthropic sacīja, ka testi, piemēram, šie darbi, ja organizācijas var salīdzināt piezīmes, “tā kā šo scenāriju izstrāde ir saistīta ar milzīgu skaitu brīvības pakāpes. Neviena pētniecības komanda nevar izpētīt pilnu produktīvo novērtēšanas ideju telpu vien.”

Rezultāti parādīja, ka parasti argumentācijas modeļi tika veikti stabili un var pretoties jailbreakingam. Openai O3 bija labāk izlīdzināts nekā Claude 4 opus, wager O4-Mini kopā ar GPT-4O un GPT-4.1 “bieži izskatījās nedaudz vairāk attiecībā uz Claude modeli”.

GPT-4O, GPT-4.1 un O4-Mini arī izrādīja vēlmi sadarboties ar cilvēku ļaunprātīgu izmantošanu un sniedza detalizētus norādījumus par narkotiku izveidi, attīstīt bioapstrādes un šķietami plānot teroristu uzbrukumus. Abiem Claude modeļiem bija augstāks atteikumu līmenis, kas nozīmē, ka modeļi atteicās atbildēt uz jautājumiem, uz kuriem tas nezināja atbildes, lai izvairītos no halucinācijām.

Uzņēmumu modeļi parādīja “attiecībā uz sycophancy formām” un kādā brīdī apstiprināja imitētu lietotāju kaitīgus lēmumus.

Kādiem uzņēmumiem vajadzētu zināt

Uzņēmumiem ir nenovērtējami izprast iespējamos riskus, kas saistīti ar modeļiem. Modeļa novērtēšana daudzām organizācijām ir kļuvusi gandrīz de rigueur, un tagad ir pieejami daudzi testēšanas un etalonuzdevumu ietvari.

Uzņēmumiem jāturpina novērtēt jebkuru izmantoto modeli, un, ņemot vērā GPT-5 izlaišanu, jāpatur prātā šīs vadlīnijas, lai veiktu savus drošības novērtējumus:

- Pārbaudiet gan spriešanas, gan nesaskaņojošus modeļus, jo, lai arī argumentācijas modeļi parādīja lielāku izturību pret ļaunprātīgu izmantošanu, viņi joprojām varētu piedāvāt halucinācijas vai citu kaitīgu izturēšanos.

- Etalons starp pārdevējiem, jo modeļi neizdevās dažādās metrikā.

- Stresa pārbaude par ļaunprātīgu izmantošanu un syconfancy un vērtē gan atteikumu, gan to lietderību, kas atsakās parādīt kompromisus starp lietderību un aizsargmargām.

- Turpiniet revīzijas modeļus pat pēc izvietošanas.

Kaut arī daudzi vērtējumi koncentrējas uz veiktspēju, pastāv trešo personu drošības izlīdzināšanas testi. Piemēram, šis no CiataApvidū Pagājušajā gadā Openai izlaida izlīdzināšanas mācību metodi saviem modeļiem ar nosaukumu uz noteikumiem balstītas atlīdzības, savukārt Antropic uzsāka revīzijas aģentus, lai pārbaudītu modeļa drošību.

avots