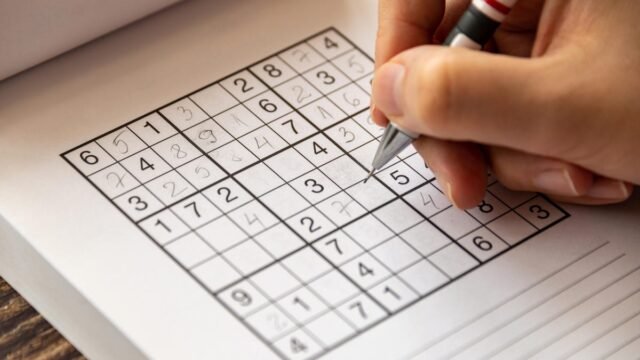

Tērzēšanas roboti ir patiesi iespaidīgi, kad vērojat, kā viņi dara lietas, kurās viņi ir labi, piemēram, rakstot pamata e-pastu vai veidojot dīvainus futūristiska izskata attēlus. Bet palūdziet ģeneratīvo AI atrisināt vienu no šīm mīklām avīzes aizmugurē, un lietas var ātri iziet no sliedēm.

Tas ir tas, ko Kolorado Universitātes Bouldera pētnieki atrada, kad viņi izaicināja lielo valodu modeļus, lai atrisinātu Sudoku. Un pat ne standarta 9×9 mīklas. Vieglāka 6×6 mīkla bieži pārsniedza LLM iespējas bez ārējas palīdzības (šajā gadījumā konkrēti mīklu risināšanas rīki).

Svarīgāks atklājums nāca, kad modeļiem tika lūgts parādīt savu darbu. Lielākoties viņi to nevarēja. Dažreiz viņi meloja. Dažreiz viņi izskaidroja lietas tādā veidā, kam nebija jēgas. Dažreiz viņi halucinēja un sāka runāt par laika apstākļiem.

Ja Gen AI rīki nevar precīzi vai caurspīdīgi izskaidrot savus lēmumus, tāpēc mums vajadzētu būt piesardzīgiem, jo mēs šīm lietām piešķiram lielāku kontroli pār savu dzīvi un lēmumiem, sacīja Ashutosh Trivedi, Kolorādo universitātes Boulderas autoram, un viens no Kolorādo universitātes autoriem, un viens no papīrpapīrs Publicēts jūlijā skaitļošanas valodniecības asociācijas atklājumos.

“Mēs ļoti vēlētos, lai šie skaidrojumi būtu caurspīdīgi un atspoguļotu to, kāpēc AI pieņēma šo lēmumu, nevis AI, kurš mēģina manipulēt ar cilvēku, sniedzot paskaidrojumu, kas cilvēkam varētu patikt,” sacīja Trivedi.

Kad jūs pieņemat lēmumu, varat mēģināt to pamatot vai vismaz izskaidrot, kā jūs tajā nonācāt. AI modelis, iespējams, nespēj precīzi vai pārredzami rīkoties tāpat. Vai jūs tam uzticētos?

Skatieties šo: Telsa atzina par atbildīgu par autopilota negadījumu, tarifi sāk ietekmēt cenas un vairāk | Tech šodien

Kāpēc LLM cīnās ar Sudoku

Mēs esam redzējuši, ka AI modeļi neizdodas pamata spēlēs un mīklās. Openai Chatgpt (cita starpā) datora pretinieks ir pilnībā saspiests pie šaha 1979. gada Atari spēlē. Nesenā Apple pētījumā tika atklāts, ka modeļi var cīnīties ar Citas mīklas, piemēram, Hanojas tornisApvidū

Tam ir sakars ar to, kā darbojas LLMS un aizpilda informācijas nepilnības. Šie modeļi mēģina pabeigt šīs nepilnības, pamatojoties uz to, kas notiek līdzīgos gadījumos viņu apmācības datos vai citās lietās, ko viņi ir redzējuši iepriekš. Ar Sudoku jautājums ir loģika. AI, iespējams, mēģinās aizpildīt katru spraugu secībā, pamatojoties uz to, kas šķiet saprātīga atbilde, bet, lai to pareizi atrisinātu, tā vietā ir jāaplūko viss attēls un jāatrod loģisks pasūtījums, kas mainās no mīkla uz mīklu.

Lasīt vairāk: AI Essentials: 29 veidi, kā jūs varat likt Gen AI strādāt jūsu labā, pēc mūsu ekspertu domām

Tērzboti ir slikti šahā līdzīga iemesla dēļ. Viņi atrod loģiskus nākamos gājienus, bet ne vienmēr domā trīs, četri vai pieci gājieni uz priekšu – pamatprasme, kas nepieciešama, lai labi spēlētu šahu. Tērzēšanas roboti dažreiz mēdz pārvietot šaha gabalus tādā veidā, kas īsti neievēro noteikumus vai ievieto gabalus bezjēdzīgā apdraudējumā.

Jūs varētu gaidīt, ka LLMS spēs atrisināt Sudoku, jo tie ir datori un mīkla sastāv no skaitļiem, bet pašas mīklas nav īsti matemātiskas; Viņi ir simboliski. “Sudoku ir slavena ar to, ka tā ir mīkla ar numuriem, ko varētu izdarīt ar jebko, kas nav skaitlis,” sacīja Fabio Somenzi, CU profesors un viens no pētniecības darba autoriem.

Es izmantoju pētnieku papīra paraugu un iedevu to Chatgpt. Šis rīks parādīja savu darbu un vairākkārt man teica, ka tam ir atbilde, pirms parādīja mīklu, kas nedarbojās, pēc tam atgriezties un labot. Tas bija tā, it kā robots pagrieztos prezentācijā, kas turpināja saņemt pēdējās sekundes labojumus: šī ir pēdējā atbilde. Nē, patiesībā, nekad nedomājiet, šis ir galīgā atbilde. Tas galu galā saņēma atbildi, izmantojot izmēģinājumu un kļūdu. Bet izmēģinājums un kļūda nav praktisks veids, kā cilvēks var atrisināt Sudoku avīzē. Tas ir pārāk daudz dzēšam un sabojā jautrību.

AI cīnās, lai parādītu savu darbu

Kolorādo pētnieki ne tikai gribēja noskaidrot, vai roboti varētu atrisināt mīklas. Viņi lūdza paskaidrojumus par to, kā robotprogrammatūras darbojās caur tiem. Lietas gāja labi.

Pārbaudot Openai O1-preView argumentācijas modeli, pētnieki redzēja, ka skaidrojumi-pat pareizi atrisinātām mīklām-precīzi nepaskaidro vai attaisnoja viņu gājienus un nepareizi saņēma pamatnoteikumus.

“Viena lieta, kas viņiem ir laba, ir skaidrojumu sniegšana, kas šķiet saprātīgi,” sacīja Marija Pačeko, CU datorzinātņu docente. “Viņi pielāgojas cilvēkiem, tāpēc viņi iemācās runāt tā, kā mums tas patīk, bet tas, vai viņi ir uzticīgi tam, kas faktiskajiem soļiem ir jāatrisina, lai atrisinātu lietu, ir tas, kur mēs mazliet cīnāmies.”

Dažreiz skaidrojumiem bija pilnīgi nebūtiski. Kopš papīra darba pabeigšanas pētnieki turpināja pārbaudīt jaunus atbrīvotos modeļus. Somenzi sacīja, ka tad, kad viņš un Trivedi vadīja Openai O4 spriešanas modeli, izmantojot tos pašus testus, vienā brīdī šķita pilnībā atteicies.

“Nākamais jautājums, ko mēs uzdevām, atbilde bija Denveras laika prognoze,” viņš teica.

(Informācijas atklāšana: CNET mātesuzņēmums Zifs Deiviss aprīlī iesniedza tiesas procesu pret Openai, apgalvojot, ka tas pārkāpj Ziff Davis autortiesības apmācībā un darbībā tās AI sistēmās.)

Izskaidrot sevi ir svarīga prasme

Atrisinot mīklu, jūs gandrīz noteikti spējat staigāt kādu citu caur jūsu domāšanu. Fakts, ka šie LLM neizdevās tik iespaidīgi šajā pamatdarbā, nav triviāla problēma. Tā kā AI uzņēmumi pastāvīgi runā par “AI aģentiem”, kas var rīkoties jūsu vārdā, ir svarīgi izskaidrot sevi.

Apsveriet darbavietu veidus, kas tiek piešķirti AI tagad, vai plānoti tuvākajā laikā: nodokļu nodošana, nodokļu veikšana, biznesa stratēģiju izlemšana un svarīgu dokumentu tulkošana. Iedomājieties, kas notiktu, ja jūs, kāds cilvēks, darījāt kādu no šīm lietām un kaut kas nogāja greizi.

“Kad cilvēkiem ir jānovieto seja lēmumu priekšā, viņi labāk spēs izskaidrot, kas noveda pie šī lēmuma,” sacīja Somenzi.

Tas nav tikai jautājums par saprātīgas atbildes saņemšanu. Tam jābūt precīzam. Kādu dienu AI paskaidrojumam par sevi varētu nākties noturēties tiesā, bet kā tās liecības var uztvert nopietni, ja ir zināms, ka tā melo? Jūs neuzticētos personai, kurai neizskaidroja sevi, un jūs arī neuzticētos kādam, kuru atradāt, sakot, ko patiesības vietā vēlaties dzirdēt.

“Paskaidrojuma iegūšana ir ļoti tuvu manipulācijai, ja tas tiek darīts nepareiza iemesla dēļ,” sacīja Trivedi. “Mums jābūt ļoti uzmanīgiem attiecībā uz šo skaidrojumu caurspīdīgumu.”

![Amazon atlaides AirPods no 4 līdz USD 89,99 un AirPods Professional 2 līdz 169 USD [Updated]](https://motozurnals.lv/wp-content/uploads/2025/08/1756049957_Airpods-Pro-2-Discount-Feature-Orange-238x178.jpg)