Tā kā arvien vairāk uzņēmumu ātri sāk izmantot gen AI, ir svarīgi izvairīties no lielas kļūdas, kas varētu ietekmēt tā efektivitāti: pareizas ieviešanas. Uzņēmumi tērē laiku un naudu, lai apmācītu jaunus cilvēkus, lai gūtu panākumus, taču, izmantojot lielos valodas modeļa (LLM) palīgus, daudzi tos uzskata par vienkāršiem rīkiem, kuriem nav nepieciešams paskaidrojums.

Tā nav tikai resursu izniekošana; tas ir riskanti. Pētījumi liecina, ka mākslīgais intelekts ir strauji virzījies no testēšanas līdz faktiskajai lietošanai 2024.–2025. gadā. gandrīz trešdaļa uzņēmumu ziņo par strauju lietošanas un pieņemšanas pieaugumu salīdzinājumā ar iepriekšējo gadu.

Varbūtības sistēmām ir nepieciešama pārvaldība, nevis vēlmju domāšana

Atšķirībā no tradicionālās programmatūras, gen AI ir iespējamība un adaptīva. Tas mācās no mijiedarbības, var novirzīties, mainoties datiem vai lietojumam, un darbojas pelēkajā zonā starp automatizāciju un aģentūru. Izturoties pret to kā pret statisku programmatūru, tiek ignorēta realitāte: bez uzraudzības un atjauninājumiem modeļi degradējas un rada kļūdainas izejas: parādība, kas plaši pazīstama kā modeļa dreifs. Gen AI trūkst arī iebūvēta organizatoriskā inteliģence. Modelis, kas apmācīts interneta datu izmantošanā, var uzrakstīt Šekspīra sonetu, taču tas nezinās jūsu eskalācijas ceļus un atbilstības ierobežojumus, ja vien jūs to nemācat. Regulatori un standartu iestādes ir sākušas virzīt norādījumus tieši tāpēc, ka šīs sistēmas darbojas dinamiski un var halucinēt, maldināt vai nopludināt datus ja tas nav atzīmēts.

Reālās izmaksas par iekāpšanas izlaišanu

Ja LLM halucinē, nepareizi interpretē signālu, nopludina sensitīvu informāciju vai pastiprina neobjektivitāti, izmaksas ir taustāmas.

-

Dezinformācija un atbildība: Kanādas tribunāls saukta pie atbildības Air Canada pēc tam tās tīmekļa vietnes tērzēšanas robots sniedza pasažierim nepareizu informāciju par politiku. Spriedums skaidri norādīja, ka uzņēmumi joprojām ir atbildīgi par savu AI aģentu paziņojumiem.

-

Apkaunojošas halucinācijas: 2025. gadā sindicēts “vasaras lasīšanas saraksts”, ko nes Čikāgas Solar-Occasions un Filadelfijas jautātājs ieteicamās grāmatas, kas neeksistēja; rakstnieks bija izmantojis AI bez atbilstošas pārbaudes, izraisot atsaukšanu un atlaišanu.

-

Novirze mērogā: Vispirms Vienlīdzīgu nodarbinātības iespēju komisija (EEOC). AI diskriminācijas izlīgums ietvēra darbā pieņemšanas algoritmu, kas automātiski noraidīja vecākus pretendentus, uzsverot, kā nepārraudzītas sistēmas var pastiprināt neobjektivitāti un radīt juridisku risku.

-

Datu noplūde: Kad darbinieki ielīmēja sensitīvu kodu pakalpojumā ChatGPT, Samsung uz laiku aizliegts publiskie AI rīki korporatīvajās ierīcēs — kļūda, no kuras var izvairīties, izmantojot labāku politiku un apmācību.

Ziņojums ir vienkāršs: neiestrādāts AI un neregulēta izmantošana rada juridisku, drošības un reputācijas ietekmi.

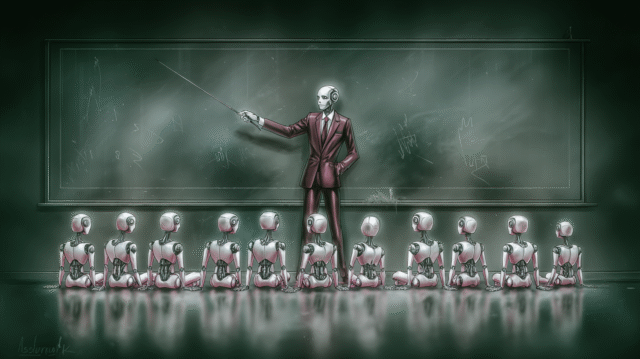

Izturieties pret AI aģentiem kā pret jauniem darbiniekiem

Uzņēmumiem AI aģenti jāiesaista tikpat apzināti kā cilvēki — ar darba aprakstiem, apmācību programmām, atgriezeniskās saites cilpām un veiktspējas pārskatiem. Tas ir starpfunkcionāls darbs, kas aptver datu zinātni, drošību, atbilstību, dizainu, HR un galalietotājus, kuri strādās ar sistēmu katru dienu.

-

Lomas definīcija. Norādiet darbības jomu, ievades/izejas, eskalācijas ceļus un pieņemamos atteices režīmus. Piemēram, juridiskais kopilots var apkopot līgumus un atklāt riskantas klauzulas, taču viņam jāizvairās no galīgiem juridiskiem spriedumiem un ir jāpaplašina sarežģītās lietas.

-

Kontekstuālā apmācība. Precīzajai skaņošanai ir sava vieta, taču daudzām komandām izguves paplašinātās paaudzes (RAG) un rīku adapteri ir drošāki, lētāki un labāk pārbaudāmi. RAG saglabā modeļus, kuru pamatā ir jūsu jaunākās, pārbaudītās zināšanas (dokumenti, politikas, zināšanu bāzes), samazinot halucinācijas un uzlabojot izsekojamību. Jaunā modeļa konteksta protokola (MCP) integrācijas ļauj vieglāk kontrolētā veidā savienot kopilotus ar uzņēmuma sistēmām — apvienojot modeļus ar rīkiem un datiem, vienlaikus saglabājot problēmu nošķiršanu. Salesforce Einšteina uzticības slānis ilustrē, kā pārdevēji formalizē drošas zemēšanas, maskēšanas un audita kontroles uzņēmuma AI.

-

Simulācija pirms ražošanas. Neļaujiet savam AI pirmajam “apmācībai” būt ar īstiem klientiem. Veidojiet augstas precizitātes smilšu kastes un stresa testa signālu, argumentāciju un malas gadījumus — pēc tam novērtējiet ar greideri. Morgan Stanley izveidoja tā novērtēšanas režīmu GPT-4 palīgskurā ir konsultanti un ātrie inženieri, kas novērtē atbildes un uzlabo uzvednes pirms plašas izlaišanas. Rezultāts: >98% adopcija starp padomdevēju komandām, kad tika sasniegti kvalitātes sliekšņi. Pārdevēji arī pāriet uz simulāciju: Salesforce nesen tika izcelts digitālā dvīņu pārbaude droši izmēģināt aģentus pret reālistiskiem scenārijiem.

-

4) Starpfunkcionālā mentorēšana. Izturieties pret agrīnu lietošanu kā a divvirzienu mācību cilpa: domēna eksperti un priekšējie lietotāji sniedz atsauksmes par toni, pareizību un lietderību; drošības un atbilstības komandas ievēro robežas un sarkanās līnijas; dizaineri veido bezberzes lietotāja interfeisus, kas veicina pareizu lietošanu.

Atsauksmju cilpas un veiktspējas pārskati — uz visiem laikiem

Uzstādīšana nebeidzas ar ieviešanu. Sākas jēgpilnākā mācīšanās pēc izvietošana.

-

Uzraudzība un novērojamība: Reģistrējiet rezultātus, izsekojiet KPI (precizitāte, apmierinātība, eskalācijas rādītāji) un novērojiet degradāciju. Mākoņu pakalpojumu sniedzēji tagad piegādā novērojamības/novērtēšanas rīkus, lai palīdzētu komandām noteikt novirzes un regresijas ražošanā, īpaši RAG sistēmām, kuru zināšanas laika gaitā mainās.

-

Lietotāju atsauksmju kanāli. Nodrošiniet produkta atzīmēšanu un strukturētas pārskatīšanas rindas, lai cilvēki varētu vadīt modeli — pēc tam aizveriet cilpu, ievadot šos signālus uzvednēs, RAG avotos vai precizēšanas kopās.

-

Regulāras revīzijas. Plānojiet saskaņošanas pārbaudes, faktu auditus un drošības novērtējumus. Microsoft uzņēmuma atbildīgais AI rokasgrāmataspiemēram, uzsvērt pārvaldību un pakāpenisku izvēršanu ar izpildvaras redzamību un skaidriem aizsargmargām.

-

Modeļu pēctecības plānošana. Attīstoties likumiem, produktiem un modeļiem, plānojiet jauninājumus un aiziešanu pensijā tā, kā plānojat cilvēku pārejas — veiciet pārklāšanās testus un pievienojiet institucionālās zināšanas (uzvednes, novērtēšanas kopas, izguves avoti).

Kāpēc tas ir steidzami tagad

Gen AI vairs nav “inovāciju plaukta” projekts — tas ir iegults CRM, atbalsta galdos, analītikas cauruļvados un izpildvaras darbplūsmās. Bankām patīk Morgan Stanley un Bank of America AI koncentrējas uz iekšējiem kopilota lietošanas gadījumiem, lai palielinātu darbinieku efektivitāti, vienlaikus ierobežojot klientu risku. Šī pieeja ir atkarīga no strukturētas ieviešanas un rūpīgas darbības jomas. Tikmēr drošības vadītāji saka, ka gen AI joprojām ir visur viena trešdaļa adoptētāju nav ieviesuši pamata riska mazināšanas pasākumusplaisa, kas aicina ēnu AI un datu ekspozīcija.

AI vietējie darbinieki sagaida arī labāku: caurspīdīgumu, izsekojamību un spēju pielāgot izmantotos rīkus. Organizācijas, kas to nodrošina, izmantojot apmācību, skaidras UX iespējas un atsaucīgas produktu komandas, redz ātrāku ieviešanu un mazāk risinājumu. Kad lietotāji uzticas otrajam pilotam, viņi izmantot tas; kad viņi to nedara, viņi to apiet.

Sagaidiet, ka iestrādei tuvojas briedums AI iespējošanas pārvaldnieki un PromptOps speciālisti vairākās organizāciju diagrammās, veidojot uzvednes, pārvaldot izguves avotus, palaist eval suites un koordinējot starpfunkcionālos atjauninājumus. Microsoft iekšējā Copilot ieviešana norāda uz šo darbības disciplīnu: izcilības centri, pārvaldības veidnes un izpildvaras izvietošanas rokasgrāmatas. Šie praktizētāji ir “skolotāji”, kas AI saskaņo ar strauji mainīgiem biznesa mērķiem.

Praktisks apmācības kontrolsaraksts

Ja ieviešat (vai glābjat) uzņēmuma otro pilotu, sāciet šeit:

-

Uzrakstiet darba aprakstu. Darbības joma, ieejas/izejas, signāls, sarkanās līnijas, eskalācijas noteikumi.

-

Iezemējiet modeli. Ieviest RAG (un/vai MCP stila adapterus), lai izveidotu savienojumu ar autoritatīviem, piekļuves kontrolētiem avotiem; ja iespējams, dodiet priekšroku dinamiskai zemēšanai, nevis plašai precizēšanai.

-

Izveidojiet simulatoru. Izveidot skriptu un iesētu scenārijus; mēra precizitāti, pārklājumu, toni, drošību; lai absolvētu posmus, ir nepieciešama cilvēka pierakstīšanās.

-

Sūtīt ar aizsargmargām. DLP, datu maskēšana, satura filtri un audita pēdas (skatiet pārdevēju uzticamības slāņus un atbildīgo AI standartus).

-

Instrumentu atgriezeniskā saite. Produkta atzīmēšana, analīze un informācijas paneļi; ieplānot iknedēļas šķirošanu.

-

Pārskatiet un pārkvalificējiet. Ikmēneša saskaņošanas pārbaudes, ceturkšņa faktu revīzijas un plānotie modeļu uzlabojumi — ar blakus A/B, lai novērstu regresiju.

Nākotnē, kurā katram darbiniekam ir AI komandas biedrs, organizācijas, kuras nopietni uztver iesaistīšanos, pārvietosies ātrāk, drošāk un mērķtiecīgāk. Gen AI nav nepieciešami tikai dati vai aprēķini; tai ir vajadzīgi norādījumi, mērķi un izaugsmes plāni. Uzskatot AI sistēmas par mācāmiem, pilnveidojamiem un atbildīgiem komandas locekļiem, ažiotāža kļūst par ierastu vērtību.

Dhyey Mavani paātrina ģeneratīvo AI LinkedIn.